האם הבינה המלאכותית הופכת לקניבלית?

מנגנון ההרס העצמי של הבינה המלאכותית

הקדשנו פוסטים רבים להסברים על הבינה המלאכותית, מאז שהיא פרצה לחיינו בסוף 2022. התייחסנו ליתרונות העצומים שיש לה בתחום החינוך ובחיינו בכלל. כתבנו גם על האתגרים שהיא מציבה בפנינו בהוראה ובלמידה ועל האופן שבו היא עשויה לשנות את חיינו כפי שאנחנו מכירים אותם.

תכנים שמיוצרים על ידי הבינה המלאכותית – טקסטים, תמונות, סרטונים, קטעי קול – מציפים אותנו בכל מקום. באופן אירוני, הכמות האדירה של התוכן המיוצרת על ידי הבינה המלאכותית יכולה להיות האיום הגדול ביותר על הבינה המלאכותית היוצרת עצמה. הכרו את התופעה קניבליזם דיגיטלי.

קניבליזם דיגיטלי: הבינה המלאכותית ניזונה מעצמה

נחזור לבסיס: כדי לייצר את הטקסטים, את התמונות, את הסרטונים ואת המנגינות המדהימות שבוודאי נחשפתם אליהם, מנועי הבינה המלאכותית צריכים להתאמן על כמות עצומה של מידע. עד כה, מערכות האימון ניזונו מתוכן אנושי: ספרים, מאמרים, תצלומים, יצירות אומנות. אבל זה לא מספיק! כדי ליצור תוצרים איכותיים יותר, דרושים למנועי הבינה המלאכותית עוד ועוד פריטי מידע. באינטרנט כבר קיימת כמות גדולה מאוד של תוכן סינטטי, כלומר, תוכן שנוצר על ידי גורם לא אנושי, קרי, הבינה המלאכותית. כאשר מנועי הבינה המלאכותית ניגשים למאגרי מידע אינטרנטיים לצורך אימון, לא מן הנמנע שחלק מהתוכן יהיה סינטטי. למעשה, אין היום דרישה לתייג תוכן כסינטטי, כך שקשה מאוד להימנע מחדירה של בינה מלאכותית למאגרי האימון.

מה הבעיה עם אימון הבינה המלאכותית בתוכן סינטטי?

חוקר הבינה המלאכותית Jathan Sadowski כינה את האימון של הבינה המלאכותית בתוכן סינטטי "תופעת ההבסבורג AI", על שם שושלת המלוכה האוסטר־הונגרית. נישואי קרובים היו שכיחים מאוד בשושלת הזו (כפי שהיו גם בשושלות אחרות) והתוצאה הייתה הולדת צאצאים רבים עם פגמים גנטיים.

לפי האנלוגיה הזו, כאשר הבינה המלאכותית מאמנת את עצמה על תוכן שהיא עצמה יצרה, נוצרים פגמים בתהליך הלמידה של המודל ויש ירידה באיכות התוצרים.

חוקרים מאוניברסיטת Rice שבארצות הברית פרסמו לאחרונה מאמר בשם

Self-Consuming Generative Models Go MAD שבו הם טבעו את ראשי התיבות MAD – Model Autophagy Disorder – הפרעת אכילה עצמית של מודלים (יש כאן רמיזה למחלת הפרה המשוגעת). החוקרים הראו שאחרי חמישה סבבים של אימון מערכות בינה מלאכותית על תוכן סינטטי, המודל "התפוצץ" כדברי פרופ' ריצ'רד ברניוק, שעמד בראש קבוצת המחקר.

במאמר נוסף שהתפרסם בכתב העת Nature, קבוצה של חוקרים וביניהם גם הישראלי פרופ' ירין גל, טענו שהאימון הלולאתי של מנועי בינה מלאכותית יביא בסופו של דבר לקריסת המודלים.

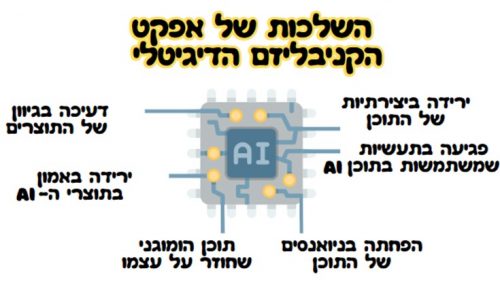

מה ההשלכות של התופעה?

ההשפעות של תופעת MAD יכולות להיות משמעותיות. ככל שמודלי הבינה המלאכותית ימשיכו להתאמן על תוכן המיוצר על ידי הבינה המלאכותית נראה את התופעות הבאות:

השלכות התופעה על חינוך ומחקר

ההשפעה של בעיית האימון של מנועי הבינה המלאכותית, חורגת מעבר ליצירת תוכן כללי ונוגעת גם למחקר ולחינוך.

כלים מבוססי AI תומכים בעבודת המורים ומעשירים אותה בהתאמת חוויות הלמידה האישית של הלומדים, בתהליכי הערכה, בפיתוח מערכי שיעור יצירתיים ועוד. אולם, אם הכלי AI יסתמכו יותר מדי על נתונים שנוצרו על ידי AI, אנחנו עלולים להגיע למצב שבו רכיבי החשיבה הביקורתית, היצירתיות והמגוון הרעיוני ייעדרו מתוצרי הבינה המלאכותית היוצרת.

באקדמיה, שבה החשיבה היצירתית והמיומנויות הביקורתיות הן עוגנים משמעותיים ביותר, הסתמכות על כלי AI שמאומנים על מידע שהם עצמם יצרו, עשויה לפגוע בהתקדמות האקדמית. אם כלי AI יהיו מבוססים על אימון שכולל נתונים יותר ויותר הומוגניים, חוקרים ייתקלו בקושי ביצירת ניתוחים חדשניים.

אז מה? צריך להפסיק להשתמש בבינה מלאכותית?

ממש לא!

אנחנו לא צריכים להפסיק להשתמש בבינה מלאכותית, אבל אנחנו צריכים להיות מודעים לקושי ולהשתמש בכלי ה־AI באופן מודע.

לבינה מלאכותית יש פוטנציאל אדיר לקדם את החינוך בפרט ואת האנושות בכלל, אבל בדומה לכל כלי, יש להשתמש בו באופן מושכל.

המפתח הוא באיזונים.

חשוב לדאוג לשלב בתוכן המיוצר בבינה מלאכותית תובנות אנושיות, וכך נצליח לשמור על כך שהמאגר הגנטי של הבינה המלאכותית יהיה עשיר ומגוון. כך הטכנולוגיה תמשיך להתפתח באופן בריא ויעיל.

לאנשי חינוך יכול להיות תפקיד חשוב בתהליך הזה על ידי קידום שימוש ביקורתי בכלי הבינה המלאכותית, תוך בירור מתמיד של מקור המידע ומאגר האימונים של מנוע הבינה.

והכי חשוב – גם כשהבינה המלאכותית יודעת לעשות את זה לא רע,

חשוב להמשיך ולהפיק מידע אנושי, והרבה!

רוצים לדעת עוד? היכנסו לקישורים המצורפים

AI Appears to Be Slowly Killing Itself

When AI Is Trained on AI-Generated Data, Strange Things Start to Happen